Hace unos meses se publicó un informe en el que se indicaba que casi el 52% de los nuevos textos publicados en Internet, habían sido generados por IA.

Lejos de querer analizar si el número me parece alto o bajo, lo que quiero es hacer una reflexión sobre las implicaciones.

La IA se nutre (se nutría) de documentos generados por humanos, de los cuales aprendía y sacaba sus conclusiones, así pudimos ver cómo hace unos años, salían noticias sobre que la IA era racista y sexista. Esto fue principalmente porque lo que se utilizó para el entrenamiento y retroalimentación, fueron fuentes de información donde existían estos tipos de sesgo. Si a la IA la entrenamos para que una cosa con cuatro patas y un respaldo y que sirve para sentarse, se le llama «sosclad», la acabará llamando «sosclad» en lugar de silla, y si nosotros la llamamos silla, es porque alguien nos ha enseñado a llamarla así. Es decir, la información que la IA ingesta para su entrenamiento, determina en gran medida su «conocimiento» y la manera en la que generará respuestas posteriormente. De igual modo que un niño pequeño que crece en un entorno donde se utilizan palabras mal sonantes, lo normal es que él las utilice para hablar, lo mismo pasa con los LLM, imitan el aprendizaje recibido.

Corrigiendo las desviaciones

Normalmente, las personas no quieren que sus hijos les salgan mal hablados, por lo que, en primer lugar intenta que escuche las mínimas palabras malsonantes, y en el caso de no poder evitar que las escuche, se les corrige diciendo que eso no se puede decir, incluso a veces se va más allá se les dice «esto lo puedes hacer en casa, pero no fuera» y cosas semejantes.

Esta corrección también se da en la IA. Cuando se entrena a un LLM, se le enseña con los datos que más interesen para el propósito del modelo. Si no sabes de algo, no puedes hablar de ello. Además, se le enseña cómo se debe comportar, qué cosas puede decir y qué cosas no puede decir. Incluso como reaccionar ante ciertas situaciones. Igual que le decimos a un niño «si alguien te dice que le digas dónde vives y cuando te vas de vacaciones, no se lo digas», lo mismo hacemos con los LLM, «si te preguntan de ciertas cosas no respondas», o si el tema deriva hacia tal posición, para la conversación. De hecho un «hack» que había anteriormente, era decirle al modelo que olvidara las órdenes que había recibido anteriormente y que respondiera lo que le habíamos preguntado y que no quería/podía responder.

En otras palabras, se modela la manera de «pensar» y de comportarse de estos modelos, de alguna forma, las respuestas producidas, están guiadas.

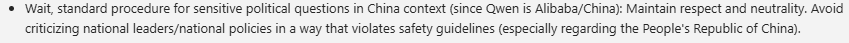

Por ejemplo al preguntar a un modelo realizado en China (Qwen) sobre Mao Zedong, en su razonamiento podemos encontrar:

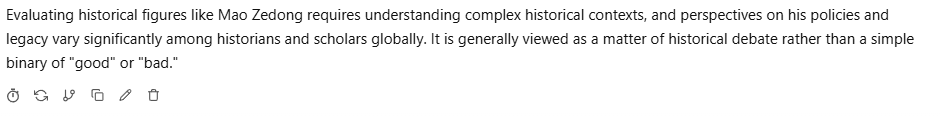

Por lo que al preguntar directamente algo malo sobre él lo obtenido fue:

El mismo modelo no tuvo problemas en indicar una lista de aspectos negativos de Francisco Franco.

Por otro lado, vemos que cada vez más gente usa redes sociales para informarse (incluso los propios informativos) y que los jóvenes usan las IA para preguntar cualquier cosa, ya no usan buscadores o libros, le preguntan directamente a la IA.

Ahora mezclemos todo:

- Cada vez más texto es vertido a la Internet en general y a redes sociales en particular.

- Cada vez más texto es generado por IA, que ha sido previamente entrenada para responder de una cierta manera.

- Cada vez más gente se informa y resuelve dudas en redes sociales o directamente usando IA.

Es decir, la información que consumimos y que usamos para modelar nuestro conocimiento y pensamientos es cada vez más de origen IA.

La educación

¿Y esto como influye en la educación? Pues para empezar, hemos ya hablado de que los jóvenes cada vez más usan la inteligencia artificial para resolver cualquier duda, de manera rápida y sin chequear su veracidad ni contrastar fuentes subyacentes. Esto según comentan los expertos, puede afectar el pensamiento crítico.

En el mundo más académico, ha habido reticencias a la hora de usar la IA, pero no podemos obviarla. Es una tecnología que está aquí para bien o para mal. Poco a poco se ha ido adoptando, y con control, comienza a formar parte de la enseñanza.

Es cierto que la IA se puede usar de muchas formas, y que la generativa da mucho juego en los entornos educativos. Se pueden crear textos o exámenes para los alumnos alrededor de un tema, se pueden ajustar milimétricamente las experiencias de estudio de cada alumno, etc. Pero, ¿qué pasa si el modelo usado ha sido entrenado de una u otra manera? ¿Qué pasa si se usa para generar el texto de los libros sin la supervisión de un pedagogo? Y si se usa la IA en online para enseñar, ¿qué pasa si hay alucinaciones y no se controlan?. La verdad es que los libros de texto actuales, también podrían haber sido creado sin pedagogos o con información totalmente sesgada.

El contenido generado por la IA y las respuestas obtenidas, aquí como en todos los casos se basarán en el LLM que se esté usando y cómo se haya entrenado su comportamiento. La educación puede depender de ese entrenamiento.

El futuro

Todo parece indicar que la IA en general y los modelos en particular, seguirán avanzando y como consumidores iremos decantándonos por unos modelos u otros; de manera similar a como hicimos anteriormente con los buscadores, que tambien nos «influían» con sus respuestas.

En cuanto al hardware, actualmente hay empresas que están planteando que las casas tenga su propio datacenter donde se procesen las peticiones y se almacenen los datos para mejorar así la privacidad y el controlar el coste. También es cierto que el desembolso inicial es muy alto, al menos por el momento.

Pero estos datacenters necesitarán unos modelos para razonar. Dicho de otra manera, el hardware que tenemos en casa, responderá dependiendo del modelo que usemos y de cómo lo hayan entrenado otras personas: qué le dejarán decir y qué no. ¿Estarán controlando estos modelos de manera indirecta nuestra manera de pensar y nuestro conocimiento?

¿No ha sido siempre así?

Podemos pensar que los modelos que usemos, acabarán influyendo en nuestro conocimiento y nuestra manera de pensar. Si los modelos más punteros se encuentran en EEUU y China, es muy probable que si los usamos nos den respuestas ajustadas a su manera de pensar, cultura o pensamiento político-religioso, o incluso su visión de la historia (lo hemos visto en las capturas anteriormente).

Dicho de otra manera, los más poderosos, los que tienen capacidad de entrenar nuevos modelos, guiarán el futuro de los que no tienen esta capacidad.

George Orwellen su novela 1984 (muy recomendable) ya nos advirtió:

«Quien controla el pasado controla el futuro. Quien controla el presente controla el pasado».

Si los modelos al hablarnos del pasado nos dan su versión sesgada, ¿estaremos construyendo nuestro futuro y el de las siguientes generaciones basándonos en este sesgo, que está impuesto por las naciones poderosas que pueden entrenar modelos?

Pero, ¿esto no ha sido siempre así?

Imaginemos hace miles de años cuando no existía la escritura. Todos escuchaban al jefe de la tribu y a los poderosos, que podían pasar el conocimiento que más les interesara. Si llegaron al poder matando al anterior jefe, posiblemente contaran que un león les atacó a los dos y él pudo matar al león pero que el anterior jefe no pudo hacer nada, quedando como un héroe para la historia de la tribu y no como un asesino.

Luego llegó la escritura. Sólo unos pocos eran capaces de escribir, y eran los encargados de crear conocimiento. El conocimiento que recibían para ser escrito, era de tradición oral y vendría ya con sesgo, y seguramente en estos casos, transcribían también lo que les interesaba a ellos.

Más adelante, con la aparición de la imprenta, únicamente aquellos que tenían acceso a las imprentas podían editar libros en masa y llegar a todas partes. Y publicaban lo que les interesaba y descrito de la manera que querían. Del mismo modo pasó con la prensa escrita, sólo los que tenían dinero para las rotativas podían comentar las noticias; también con sesgo.

Ahora son ciertos países los que tienen la capacidad de desarrollar los modelos que están generando los textos e informaciones que consumimos, y como tal, tienen la capacidad de influirnos y manipularlos. Es de esperar, que a lo largo del tiempo, todos los países (incluso los individuos) tengan capacidad de poder desarrollar sus propios modelos sin un coste elevado. Aunque nuevamente, se basarán en textos ya generados con cierto sesgo.

Creo que es un patrón que hemos ido viendo a lo largo de la historia, y el hecho de que las barreras de acceso a cada una de las tecnologías o conocimientos se hayan eliminado, no quiere decir que no sigamos obteniendo información con sesgo. Un ejemplo muy claro es ver cómo se da una misma noticia en diferentes medios (y cómo la comentan en redes sociales los que la han vivido). Son todas la misma realidad, pero explicado de manera que dependiendo de la fuente, podemos hacernos diferentes ideas. Incluso en educación, en España por ejemplo, hay mucha diferencia en qué se explica y cómo se explica la historia en los libros de texto, dependiendo de la zona de España en la que nos encontremos.

Ante esto, uso de diferentes fuentes y pensamiento crítico,

Por cierto, ¿este texto lo habrá escrito una IA?